Intel и SambaNova стартираха продукт, който може да измести Nvidia в AI сегмента

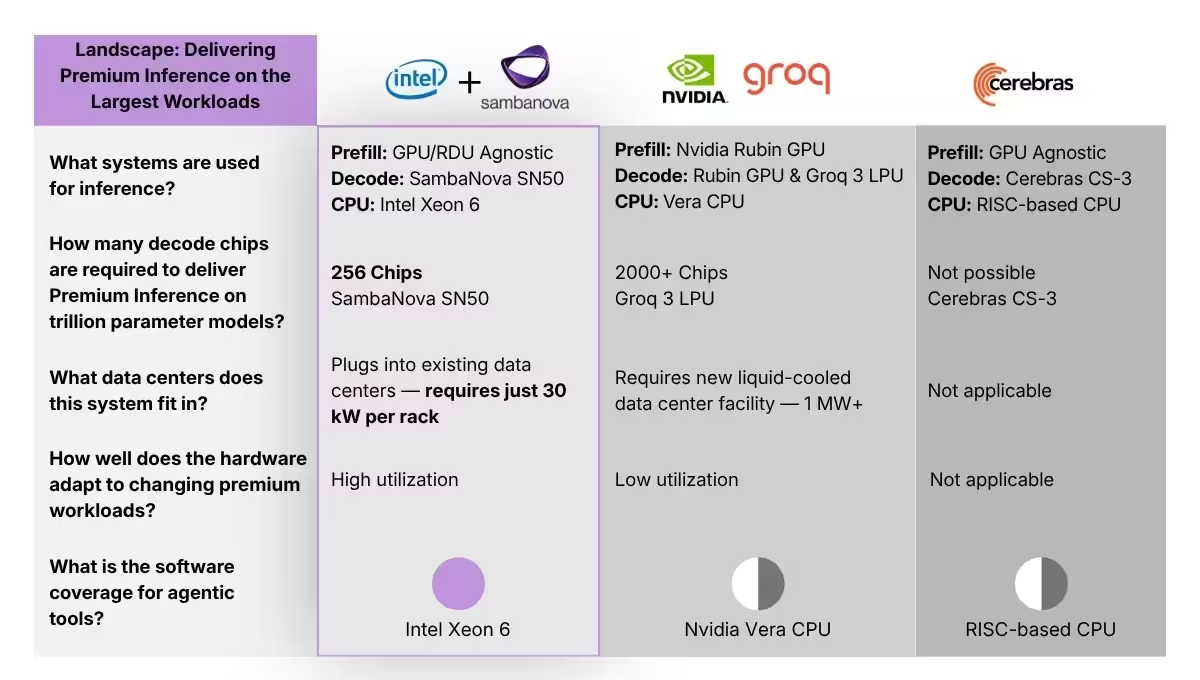

Intel и SambaNova обявиха готова за производство хетерогенна архитектура за AI умозаключения, която разпределя задачите между различни видове хардуер. Платформата използва графични процесори за предварителна обработка, специализирани модули на SambaNova за генериране на токените и процесори Xeon 6 за управление на задачите на агентите.

Разработената система разделя процеса на логическо извеждане на отделните етапи, при които всеки тип чип изпълнява специфична функция. Графичните ускорители или ускорителите на изкуствения интелект се справят с първоначалната обработка на дълги заявки (ingest) и със създаването на кешове за ключ-стойност, докато преконфигурируемите блокове за данни SN50 на SambaNova отговарят за декодирането. На свой ред процесорите Intel Xeon 6 координират балансирането на натоварването и извършват операции, свързани с AI-агентите, като компилиране на код и валидиране на резултатите. Това ще даде възможност за покриване на възможно най-широк спектър от работни натоварвания и за конкуриране с Nvidia и другите участници на пазара.

Този подход за разделяне на предварителното попълване, prefill, decode и генерирането на токени, както отбелязва Tom’s Hardware, повтаря стратегията на Nvidia в предстоящата ѝ платформа Rubin, където подобни функции трябваше да бъдат разпределени между чиповете Rubin CPX и Rubin GPU. Основната разлика обаче е, че решението на Nvidia все още не е излязло на пазара, докато Intel и SambaNova ще могат да предложат готова за внедряване архитектура още през втората половина на 2026 г.

Според вътрешните оценки на SambaNova процесорите Xeon 6 ускоряват компилирането на LLVM с повече от 50% в сравнение със сървърните чипове с архитектура Arm. Освен това производителността им при векторни задачи за бази данни е със 70% по-бърза от конкурентните x86 решения, като AMD EPYC. Според представителите на компаниите подобно повишаване на ефективността се постига чрез оптимизиране на взаимодействието между компонентите на системата и позволява да се намалят значително циклите на разработка на кодиращи агенти и други приложения за изкуствен интелект изцяло в рамките на компанията.

Основното предимство на новата архитектура е пълната ѝ съвместимост със съществуващата инфраструктура на центровете за данни, поддържащи мощности до 30 kW.

Това позволява на предприятията да внедрят решението, без да се налагат големи модернизации на системите за охлаждане и захранване. Очаква се платформата да бъде достъпна за корпоративните клиенти, облачните оператори и националните правителствени инициативи за изкуствен интелект през втората половина на 2026 г.

Кеворк Кечичян, изпълнителен вицепрезидент и генерален мениджър на Data Centre Group (DCG) на Intel, отбеляза, че софтуерната екосистема на центровете за данни исторически е изградена върху x86, което според него гарантира ролята на Xeon като солидна основа за бъдещите хетерогенни изчисления.

Всичко важно от света на технологиите, директно в пощата ти.

Всичко важно от света на технологиите, директно в пощата ти.

С абонирането приемате нашите Условия и Политика за поверителност. Може да се отпишете с един клик по всяко време.